Meta刚发布的Llama4系列模型堪称AI界的“超级核爆”,不但刷新了MoE架构的性能天花板,而且将多模态模型的实用门槛拉低到消费级硬件水平。当Llama 4的模型文件以每秒53TB的速度流向世界时,硅谷巨头的算力护城河可能正在土崩瓦解…

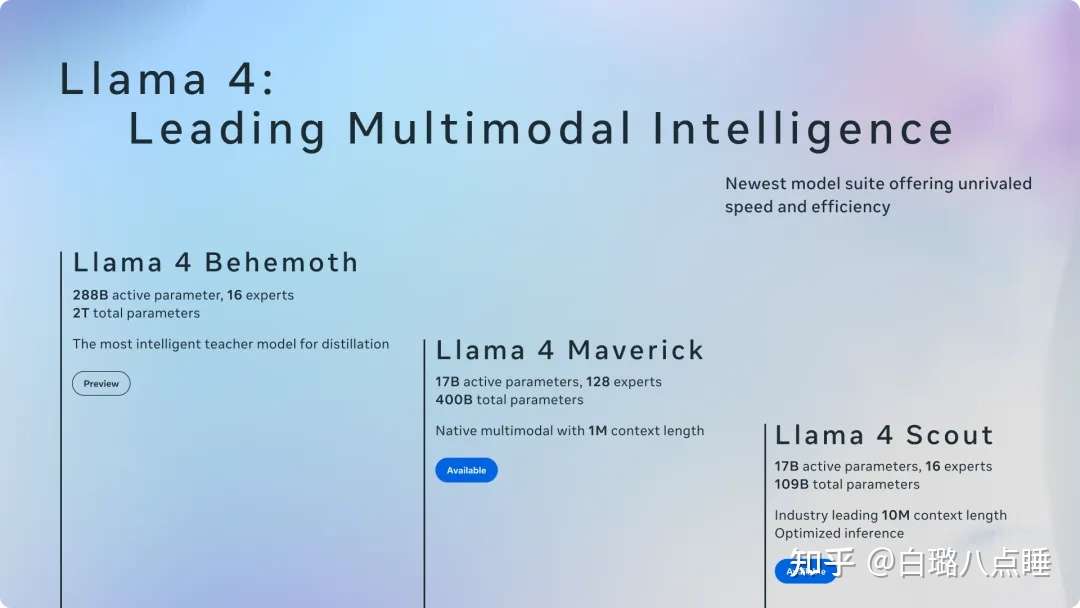

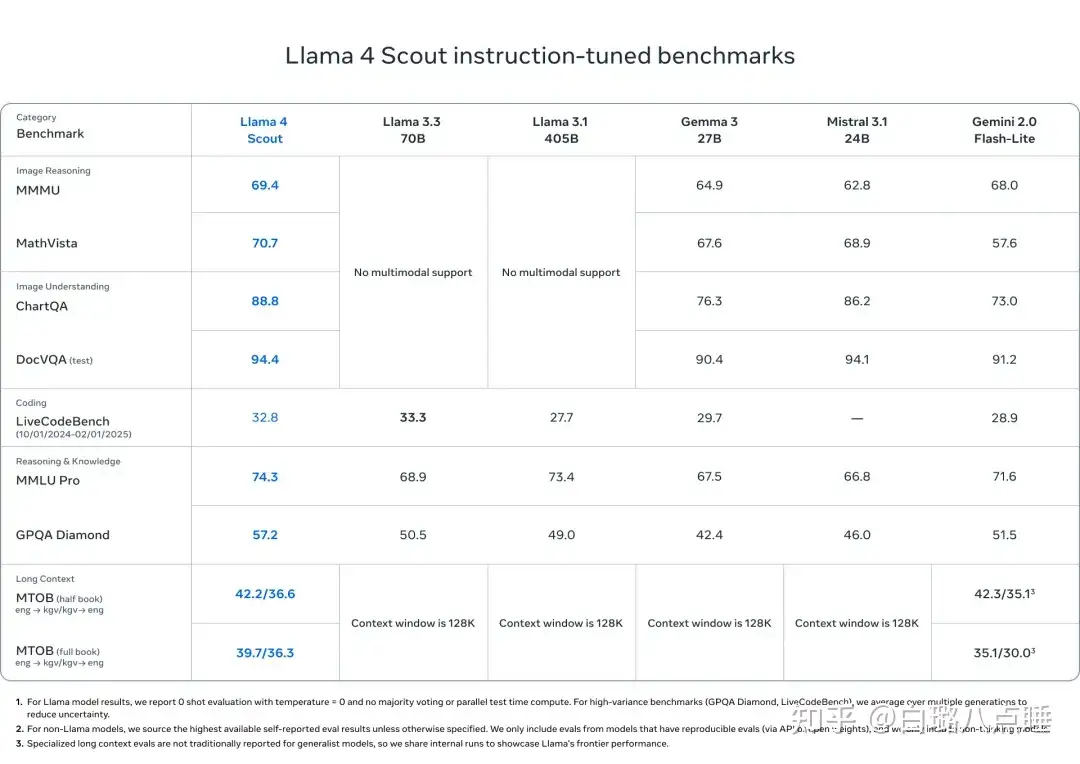

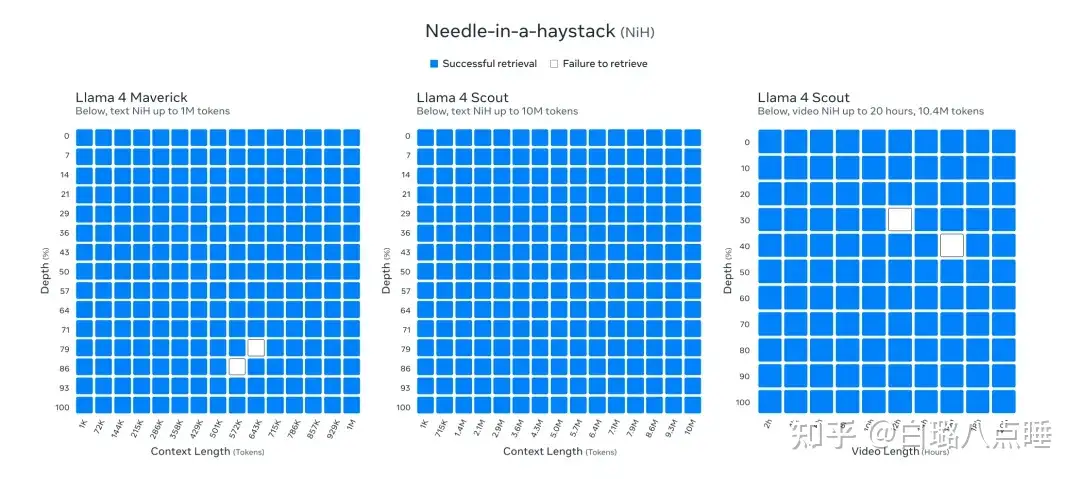

# 1. Llama 4 Scout模型是一个拥有16名专家的170亿个活动参数模型,MMMU多模态基准测试中以69.4%的准确率碾压Gemini 2.0 Flash-Lite,最重要能在单张H100显卡上实现1000万token上下文窗口,相当于能直接同时处理几部百万字巨作。

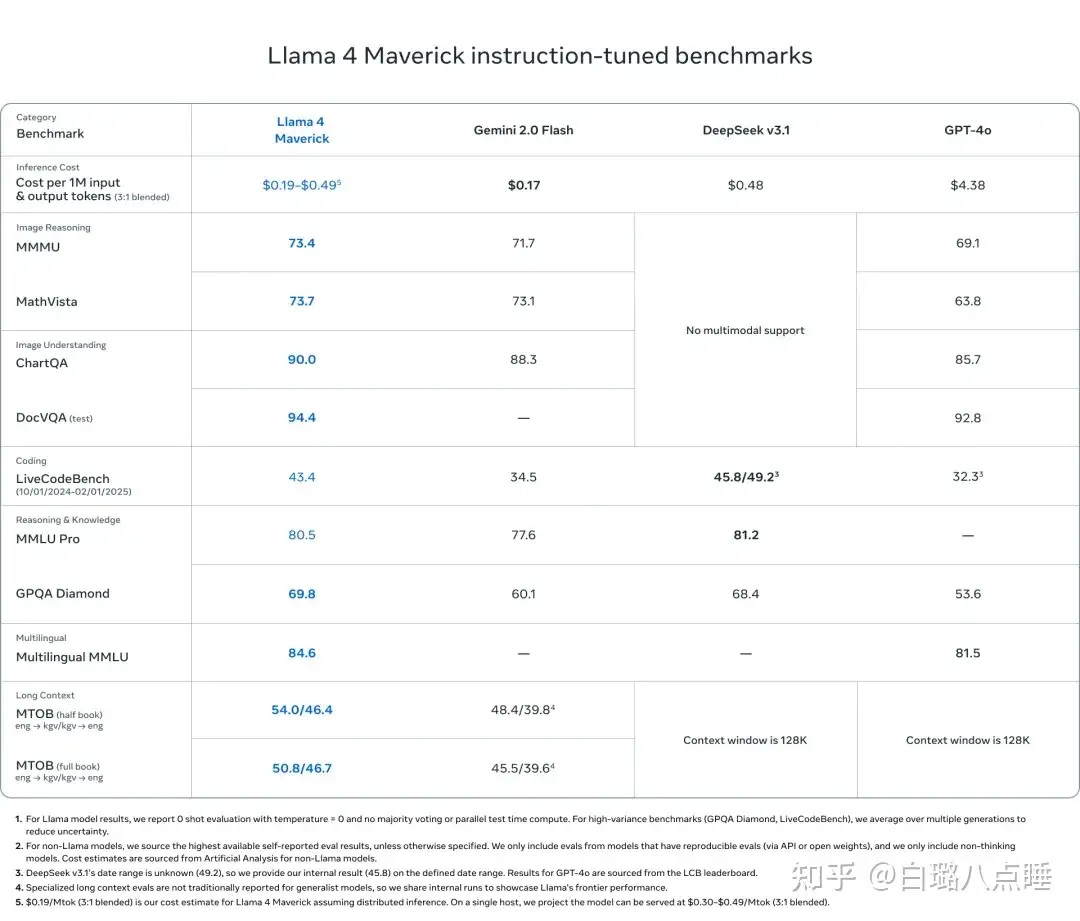

# 2. Llama 4 Maverick是一个拥有128名专家的170亿个活动参数模型,号称是全球最好的多模态模型,Maverick在LMArena上的实验性聊天版本ELO得分为1417。

Maverick主打一个性价比,4000亿总参数中仅激活17%即可在编程基准测试中追平DeepSeek-v3,每百万token 0.19$的成本,仅为同类闭源模型的1/5(DS是0.48$)。

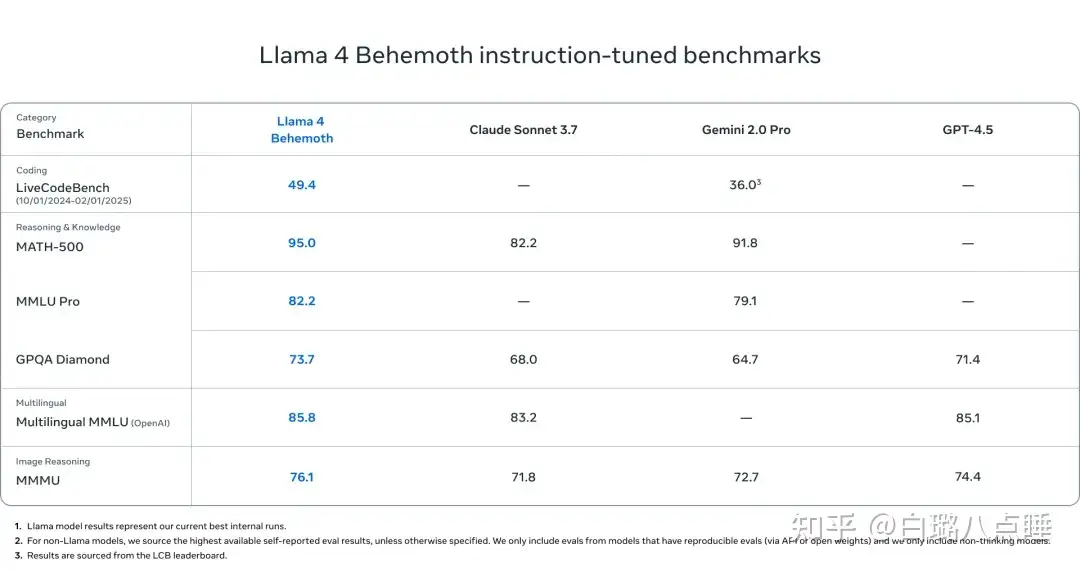

# 3. 2万亿参数的Llama 4 Behemoth教师模型仍在训练中,尚未完全开放,其参数规模相当于把全人类现有纸质书籍数字化后压缩130倍。

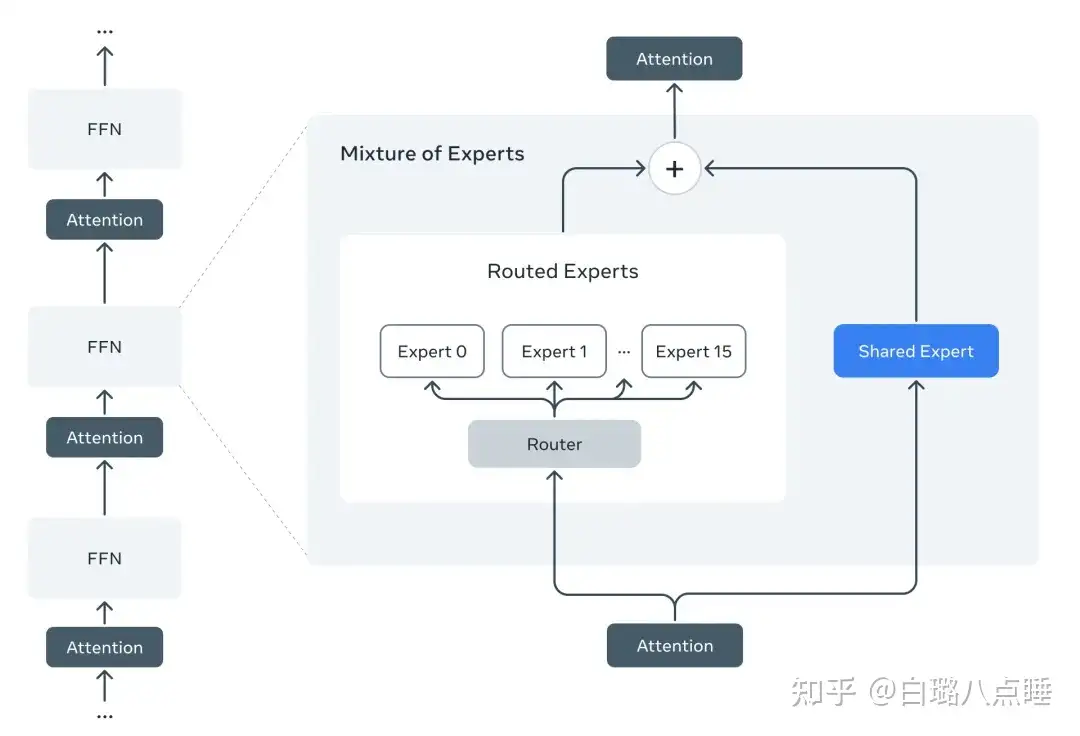

MoE架构

在DeepSeek爆火之前,它坚持不用MoE架构,这次算是完成了纠错,Llama 4模型在MoE架构中,单个令牌仅激活整体参数的一小部分,这种设计能够让MoE模型在训练和推理过程中更加计算高效,并且在固定训练FLOP预算下,相比传统的密集模型能够实现更高的质量输出。

高效推理与多模态设计

为了提升推理效率,Meta采用了交替密集层和混合专家(MoE)层的设计策略。在 MoE 层中配置了128个路由专家以及一个共享专家。每个输入令牌会被发送到共享专家,并同时被分配至128个路由专家中的一个。

尽管所有参数都存储在内存中,但在实际服务过程中,只有部分参数会被激活。这种机制大大降低了模型服务的成本和延迟,从而提高了推理效率。因此,Llama 4 Maverick 能够轻松部署在单个 NVIDIA H100 DGX 主机上,同时也支持通过分布式推理实现最大性能。

原生多模态设计

Llama 4 系列采用了原生多模态设计,结合了“早期融合”技术,将文本和视觉令牌无缝集成到统一的模型骨干中。这一设计不仅简化了模型架构,还能够利用大量未标注的文本、图像和视频数据共同预训练模型。此外,Meta在 Llama 4 中改进了视觉编码器,基于 MetaCLIP 开发了一种全新的编码器,从而更好地适配大型语言模型的需求。

MetaP超参数优化

为确保模型训练的稳定性和高效性,Meta开发了一种名为 MetaP 的新训练技术。能可靠地设置关键模型超参数,如每层学习率和初始化尺度,这些选定的超参数能够在不同批处理大小、模型宽度、深度以及训练令牌数量之间保持良好的迁移性。

多语言支持与高质量预训练

Llama 4 通过对200多种语言进行预训练,支持超过100种每种语言包含超过10亿个令牌的语言,整体多语言令牌量达到了 Llama 3 的10倍。

FP8精度与高效训练

为了进一步提升训练效率,我们在 Llama 4 的开发中引入了 FP8 精度训练技术。这种方法不仅保证了模型质量,还实现了高模型 FLOP 利用率。在使用 FP8 和32K GPU 进行 Llama 4 Behemoth 模型的预训练时,Meta成功实现了每 GPU 390 TFLOPs 的性能。整体训练数据组合包含了超过30万亿个令牌,是 Llama 3 训练数据集的两倍以上,涵盖了多样化的文本、图像和视频数据集。

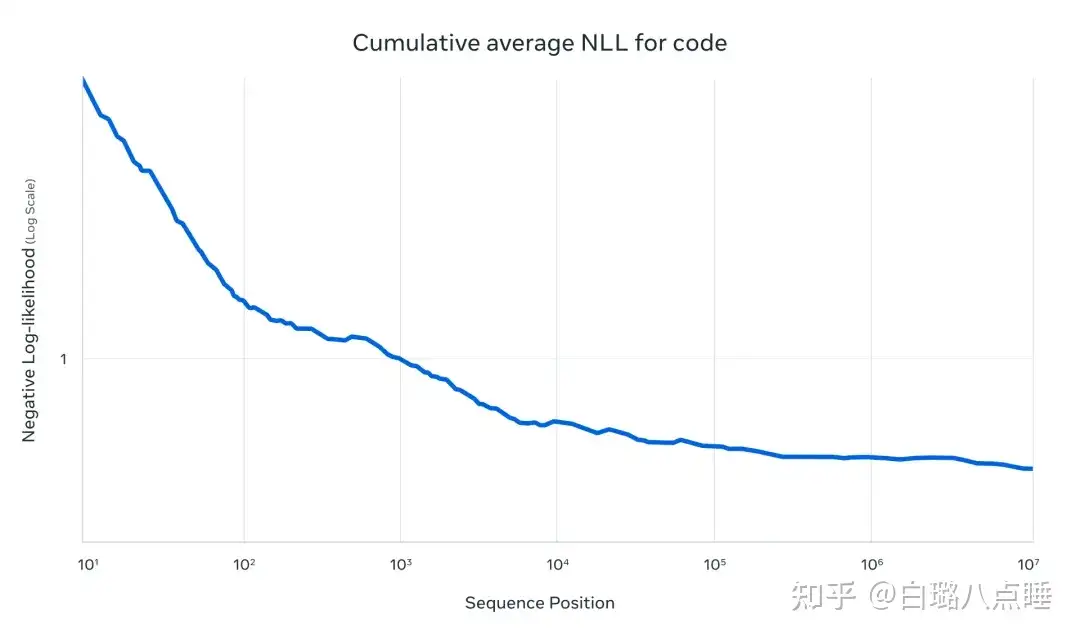

Llama 4架构技术的关键创新是使用“without positional embeddings”交错注意力层,通过使用“inference time temperature scaling”注意力来增强长度概括。称之为iRoPE架构,其中“i”代表“交错”注意力层,突出了支持“无限”上下文长度。

安全

Llama 4还构建了五层防护体系安全措施,比如预训练数据防火墙、动态安全蒸馏、威胁感知网络、系统级防护矩阵等,能实时捕获新型攻击模式。并且允许开发者在模型响应精度与安全系数之间动态平衡。实测显示,将安全等级提升至L4时,模型对敏感问题(如政治)的规避能力增强400%,而核心功能仅衰减8.7%。

OpenAII可能在几周后发布最新的推理模型o3和最新的基座模型o4-mini。DeepSeek可能在年中发布下一代推理模型R2,技术的持续突破以及各大厂商大模型的密集发布,标志着大模型领域的竞争已进入白热化阶段。

下载

在http://llama.com和Hugging Face上下载Llama 4 Scout和Llama 4 Maverick模型。在WhatsApp、Messenger、Instagram Direct和Meta.AI网站上可以使用Llama 4构建的Meta AI。